「Google Lens」登場 スマホカメラに写ったものを理解して追加情報やアクションを提示:Google I/O 2017

» 2017年05月18日 05時06分 公開

[井上輝一,ITmedia]

米Googleは5月17日(現地時間)、年次開発者会議「Google I/O 2017」で、スマートフォンのカメラに写った映像を解析するサービス「Google Lens」を発表した。同社が提供するパーソナルアシスタント機能「Google Assistant」と写真サービス「Google Photo」にまず実装される。

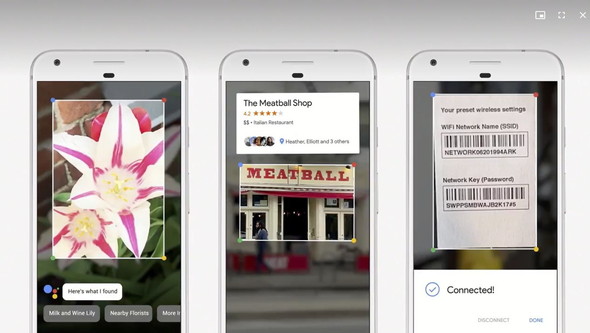

Google Lensで花を写すとユリだと認識したり、Wi-FiのSSIDとパスワードを写すとそのアクセスポイントに接続するボタンが表示されたり、街中のお店を写すと「Google Map」のお店情報を表示したりと、写ったものを理解してユーザーに役立つ情報やアクションをしてくれる。

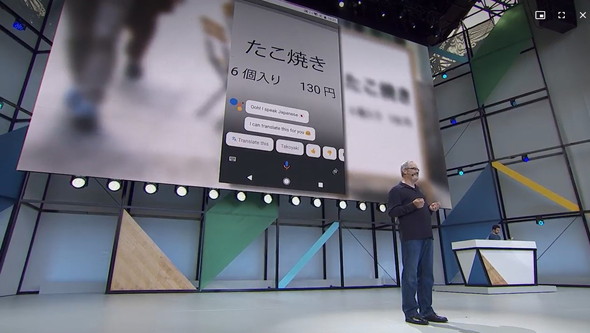

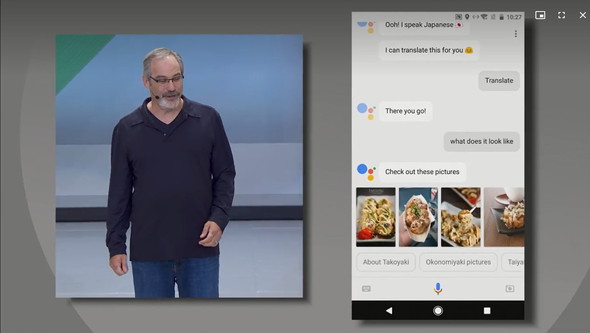

米Googleは今回の発表で「Mobile firstからAI firstへ」を掲げており、Google Lensの認識機能も機械学習によるもの。壇上では、日本語で「たこ焼き」と書かれた看板を写すと英語に翻訳し、ユーザーが「それはどんなもの?」と聞くとたこ焼きの画像が表示されるというデモも行われた。

Android Assistantは、Googleの「Pixel」シリーズのスマートフォンやAndroidアプリ「Allo」や「Duo」、これらに加えて今回iPhoneでも使用できるようになった。

関連記事

「Google I/O 2017」直前予測

「Google I/O 2017」直前予測

Googleの年次開発者会議「Google I/O」は日本時間の5月18日午前2時からライブストリーミングで視聴できる。「Google Assistant」のiOSアプリは発表されるだろうか? パーソナルアシスタント機能「Google assistant」発表――「Google Home」や新チャットアプリも

パーソナルアシスタント機能「Google assistant」発表――「Google Home」や新チャットアプリも

Googleが開発者向け会議「Google I/O 2016」で、パーソナルアシスタント機能「Google assistant」を発表。この機能を内蔵した小型デバイス「Google Home」や、新チャットアプリ「Allo」、ビデオ電話アプリ「Duo」も発表した。 パーソナルアシスタント内蔵――Googleの新型スマホ「Pixel」登場

パーソナルアシスタント内蔵――Googleの新型スマホ「Pixel」登場

Googleが開発した新型スマートフォン「Pixel」が発表された。パーソナルアシスタント機能「Google Assistant」をプリインストールしている。カメラ機能も強化し、Googleフォトに写真や動画を圧縮せずに保存できる特典も付く。 「Google Assistant」もサードパーティー端末搭載が可能に SDK公開

「Google Assistant」もサードパーティー端末搭載が可能に SDK公開

「Amazon Alexa」に続き、GoogleもAIアシスタント「Google Assistant」のSDKを公開した。「Ok Google」で操作できるサードパーティー製品の登場が期待できる。

関連リンク

Copyright © ITmedia, Inc. All Rights Reserved.

SpecialPR

SpecialPR

アクセストップ10

2026年06月11日 更新

- スマホの“ミニ”外付けディスプレイが流行の兆し? 若者がインカメラではなく「アウトカメラ」で自撮りする理由 (2026年06月10日)

- ドコモの通信障害に“AIエージェント”が先手 「SNSの投稿」も常時監視するオペレーションセンターの裏側 (2026年06月10日)

- IIJmioのスマホ大特価セール 中古「iPhone SE(第3世代)」が4980円、「OPPO Reno11 A」が9980円など (2026年06月09日)

- JR東日本が2027年春から「二次元コード乗車券」を導入 近距離券売機での磁気券は順次廃止へ (2026年06月09日)

- ソフトバンクが「今回もやる」とGalaxy S26を月額1円で販売――販売方法を早急に見直さないと撤退を迫られるメーカーも (2026年03月08日)

- iOS 27は「iPhone 11」以降で利用可能 iOS 26から据え置きで過去最大のiPhoneに対応 (2026年06月09日)

- 「Pokemon GO Fest 2026:東京」のモバイル通信は快適だった? 初対策の楽天モバイルがピーク時に“最速”も記録 (2026年06月10日)

- あなたの街の「スマホ決済」キャンペーンまとめ【6月版】〜PayPay、d払い、au PAY、楽天ペイ (2026年06月08日)

- 「iPadOS 27」発表 Siri AI対応で生産性が向上、スクショから調べ物も可能に (2026年06月09日)

- WWDCで「折りたたみiPhone」に言及なしも、Apple版「大画面×AI」に期待できるワケ (2026年06月09日)

最新トピックスPR