「Pixel 4」のカメラ技術から見える、スマホカメラの進化(1/2 ページ)

「Pixel 3」が日本へも投入されるや否や、その画質の高さや安定感が評価されたGoogleのスマートフォン。

そのGoogleがメディア向けに「Pixel 4」のカメラ技術に関する説明会を開いたので参加させてもらったのだが、これがまた、この1年のスマートフォンカメラの進化はどこにあったのかを伝える内容だったのである。

解説をしてくれたのは、Distinguished EngineerのMarc Lovoy氏。

テーマは「Googleのスマートフォンにおけるコンピュテーショナルフォトグラフィー(デジタル処理によって画像を生成する技術)と機械学習」。これ、Googleの技術について語ってくれたのだけど、今の「これ、画質いいじゃん」と思えるようなハイエンドのスマートフォンはたいてい同様の取り組みをしていると考えられるので、そういう意味でもすごく参考になったのだ。

分かりやすいように4つの例で説明してくれた。

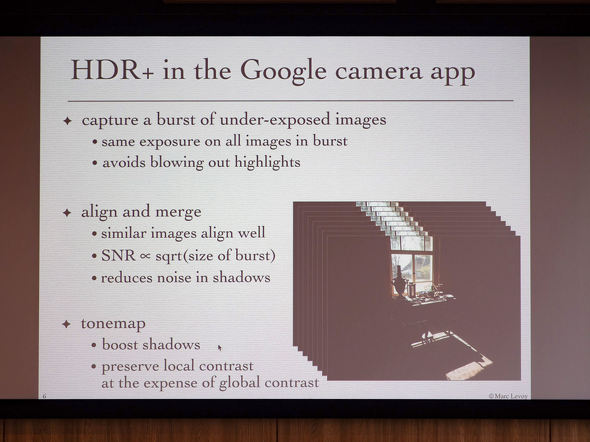

1.HDR+:Pixelでは露出不足の写真を連写

コンピュテーショナルフォトグラフィーの代表が、連写+合成だ。その代表がHDR技術で、個人的にこの数年でスマートフォンカメラの画質がぐんと上がったように見える一番の理由だと思う。

HDRはハイダイナミックレンジの略。明暗差が極端に大きな構図で明部から暗部まできちんと描写する技。今回の説明では典型的な例として、昼間の暗い室内での撮影を取り上げていた。

暗い室内に写真の明るさ(露出)を合わせると、窓の外は明るすぎて白くなってしまってディテールが分からない。逆に窓の外……つまり昼間の屋外に合わせて撮ると室内が真っ暗になってしまう。

そういうとき、複数の写真を撮影して合成することで、明るいところはちょっと抑えめに、暗いところはちょっと持ち上げて、両方がきちんと見えている写真を作る技術だ。

一般にHDR画像を作るときは、明るく撮った写真(これで室内の暗い部分をしっかり捉える)、暗く撮った写真(これで屋外の明るい部分をしっかり捉える)、中間の写真の3枚を撮り、それぞれ合成することで明暗差を抑えた画像を作る。

GoogleがHDR+で活用している技術はちょっと違う。これが面白い。

露出不足の(つまり暗めの)写真を連写で撮るのだという。その方が連写速度は上げられる。明部に合わせたセッティングで撮るのである。そうすると暗部が暗いままになる。

暗いところは足し合わせることで明るくする。暗部を無理に持ち上げるとノイズも一緒に乗ってくるが、S/N比(信号とノイズの比)は連写枚数の平方根で減っていくので、たくさん撮影してシャドー部を明るくするわけである。

ただ、それだと全体のコントラストが弱くなるので、エッジ部分のコントラストを強調することで、そう見えないよう調整する――という内容だ。今のスマートフォンカメラの画質が上がっているのは、高速なイメージセンサーと高速な画像処理によって、当たり前のように高速連写をしながら合成して絵を作り出しているからといっても過言じゃないわけで、そのとき何をしているかを解説してくれたのだ。

Pixel 4がさらに進んだのは、撮影時に画面でHDR後の状態を見られる「Live HDR」。これは機械学習によってこういうときはどう撮影されるかという近似値を持っており、撮影時にはそれを反映させ、実際に撮影したときはきちんとHDRをかけているそうだ。

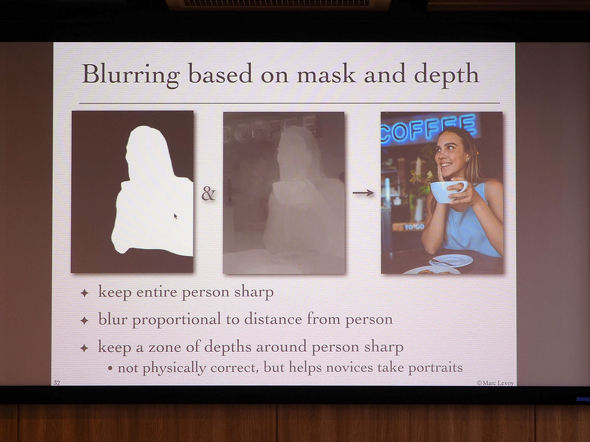

2.ポートレートモード:髪の毛や毛皮のエッジも自然に表現

もうおなじみですな。Pixel 3はカメラ1つでポートレートモード(つまり背景をボカした写真)を作っていた。Pixel 4はカメラが2つになった。

Pixel 3では2つの技を使っていた。1つはデュアルピクセルセンサーの、1つの画素を2つに分けて使えるという特性を利用して深度を測り、そこから深度図を作って背景をぼかす。もう1つは機械学習を使って人の輪郭を抽出する。これら2つを使って背景をボカしていた。

人物じゃないときは深度図のみを使っていた。Pixel 4はデュアルカメラなので深度図をより正確に作れるようになり、髪の毛や毛皮のエッジを自然に表現できるようになった。

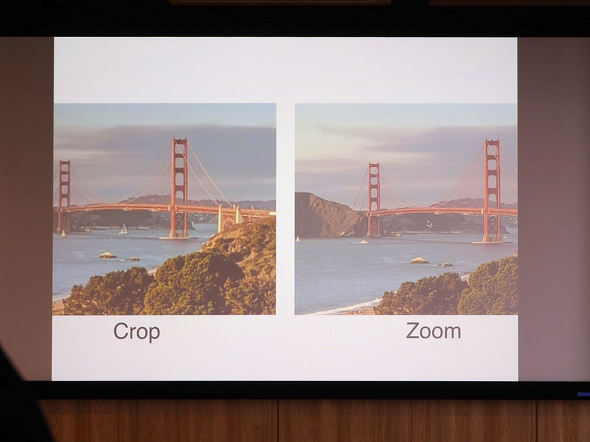

3.超解像ズーム:単なるトリミングよりキレイに

要するにデジタルズームの性能の話。手持ちで撮ると必ず微妙な手ブレが発生する。連写してそのわずかなズレを重ねることでよりディテールを補完することができるので、より高解像度の写真を撮れ、最高で光学4倍ズームに近い画像を作れる。

つまり、単に拡大して足りないところを補完しているだけじゃなくて、より細かな処理をしてディテールの情報を得ているというわけで、クロップしたものと比べて見るとその違いは一目瞭然なので、ぜひクロップ(撮った写真の一部を切り出す)よりピンチアウトズーム(つまりデジタルズーム)を使ってください、と。

デジタルズームを使って撮ったときのディテールの表現力って各社けっこう差があるのだが、この辺の技術が関係しているのだろう。

関連記事

望遠レンズ搭載で「Pixel 4」のカメラは何が変わったのか? Pixel 3と比較する

望遠レンズ搭載で「Pixel 4」のカメラは何が変わったのか? Pixel 3と比較する

シングルカメラながら、なぜか背景がちゃんとボケる賢さときれいな夜景モードと安定した画質が定評のある「Pixel 3」。その後継機となる「Pixel 4」は、デュアルカメラを搭載してきた。新たに搭載した望遠レンズを含めた実力はいかほどか? 本当に“同じ”? 「Pixel 3」と「Pixel 3a」のアウトカメラを撮り比べる

本当に“同じ”? 「Pixel 3」と「Pixel 3a」のアウトカメラを撮り比べる

Googleのスマートフォン「Pixel 3」と、その廉価版に相当する「Pixel 3a」。両者のアウトカメラは基本スペックが同じということになっているが、本当に同じなのか? 撮り比べてみるのである。 AIの力でデュアルカメラ超え? 「Pixel 3 XL」の“賢い”カメラの実力を見る

AIの力でデュアルカメラ超え? 「Pixel 3 XL」の“賢い”カメラの実力を見る

Google純正のスマートフォン「Pixel 3」「Pixel 3 XL」が日本に上陸。トレンドに逆らうようにアウトカメラはあえてシングルで、インカメラがデュアルという面白い構成。どんなものなのか、撮り試してみましょう。 ハード、ソフト、AIの三位一体で攻める「Pixel 4」 “我が道を行く”ゆえの課題も

ハード、ソフト、AIの三位一体で攻める「Pixel 4」 “我が道を行く”ゆえの課題も

10月24日にGoogleの最新スマートフォン「Pixel 4」「Pixel 4 XL」が発売される。ハードウェアとしては、デュアルカメラ化したことや、電波を使ってジェスチャーを検知する「モーションセンス」に対応した。比較されがちなiPhoneとは開発思想が異なるが、他社比較から見える課題もある。 「Pixel 4」は何が新しい? 3/3aと比較、ネックは価格か

「Pixel 4」は何が新しい? 3/3aと比較、ネックは価格か

Googleの最新スマートフォン「Pixel 4」「Pixel 4 XL」が10月24日に発売される。カメラが進化し、2020年春からは新機能の「モーションセンス」が利用可能になる予定。Pixel 3や3aとの違いをまとめつつ、Pixel 4は買いなのかどうかを考えたい。

Copyright © ITmedia, Inc. All Rights Reserved.

アクセストップ10

- 修理費で13万円超えも 折りたたみスマホに「端末保険」が事実上必須といえる理由 (2026年04月27日)

- スマホの「残価設定」にメス? 総務省がルール統一を検討も、Appleは「不当な扱い」と猛反発 (2026年04月25日)

- 3社そろい踏みの「Starlink Direct」 料金で仕掛けるドコモとソフトバンク、先行するKDDIは“サービス”で差別化 (2026年04月25日)

- 5万〜6万円台で買えるおすすめスマホ7選 ハイエンド級性能、防水+おサイフ対応、カメラ重視など多彩 (2026年04月27日)

- ダイソーで1100円の「USB充電器(PD20W)」は、きちんと20Wで充電できるのか? (2026年04月26日)

- 楽天モバイル、ルーター「Rakuten WiFi Pocket 5G」の販売を一時停止 理由は? (2026年04月24日)

- iOS向け「シンプルメモ」アプリ登場 思いついた内容を即メール送信 (2026年04月27日)

- PayPay、4自治体で最大30%還元キャンペーン 2026年6月以降 (2026年04月20日)

- ダイソーの1100円「シースルーイヤフォン」に一目ぼれ “音質と個体差”に目をつむれば「あり」な選択肢 (2026年04月23日)

- ソフトバンクが「今回もやる」とGalaxy S26を月額1円で販売――販売方法を早急に見直さないと撤退を迫られるメーカーも (2026年03月08日)