Google、マルチモーダル生成AIモデル「Gemini」発表 Ultraは“人間の専門家を上回る”

米Googleは12月6日(現地時間)、マルチモーダル生成AIモデルの第1弾として「Gemini」を発表した。データセンターからモバイルデバイスに至るまでのあらゆる場所で効率的に動作するという。

Geminiの最初のバージョンとなる1.0は「Ultra」「Pro」「Nano」の3サイズに分かれる。テキスト、画像、音声、動画、コードなど、さまざまな種類の情報を一般化してシームレスに理解し、操作し、組み合わせることができるという。これらはGoogleが「Google DeepMind」の設立時に抱いていたビジョンを実現したものだという。具体的な位置づけは次の通り。

- Gemini Ultra……非常に複雑なタスクに対応する、高性能かつ最大のモデル

- Gemini Pro……幅広いタスクに対応する最良のモデル

- Gemini Nano……デバイス上のタスクに最も効率的なモデル

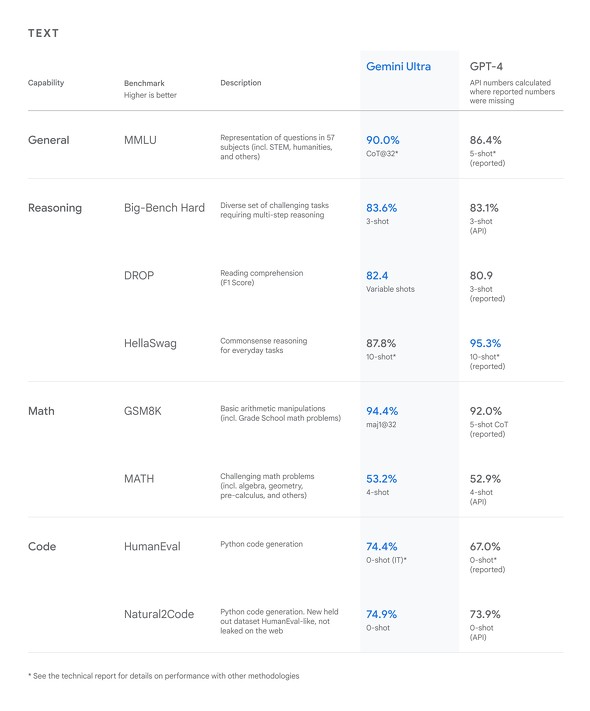

最も大きなサイズとなるUltraは自然な画像の理解から数学的推論、音声や動画の理解に至るまで、広く使用されている32の業界ベンチマークのうち30で最高の水準を記録したという。数学、物理学、歴史、法律、医学、倫理など57の科目の組み合わせて知識と問題解決能力をテストするMMLU(大規模マルチタスク言語理解)で 90.00%と高いスコアを叩き出し、“人間の専門家を上回る”パフォーマンスを示したという。

Ultraは2024年に開発者や企業に向けて公開される計画だが、その前に一部の顧客、開発者、パートナー、安全責任専門家から得たフィードバックを生かし、改良が行われる。

Proは対話型AIサービス「Bard」(英語版のみ)に実装される。Bard提供以来最大のアップデートによって、Bardは無料かつ高性能な会話型生成AIサービスに進化したという。

Nanoはデバイスだけで動作するように設計されたコンパクトなサイズのGeminiだ。「Tensor 3」プロセッサを搭載したハイエンドのスマートフォン「Pixel 8 Pro」に実装された。音声データの内容をテキストで要約できる他、キーボードアプリ「Gboard」のスマートリプライがPixel 8 Proで生成できるようになる。ただし、当面の間は英語のみでしか利用できないという。

重複するが、GoogleはGeminiを「マルチモーダルでの高度な推論性能を備えた高性能AIモデル」と紹介している。複数(マルチ)の形式と手段(モーダル)を組み合わせて、あらゆるタスクをこなす──それがマルチモーダル生成AIモデルのGeminiだ。

関連記事

「Pixel 8 Pro」にGoogleの生成AIモデル「Gemini Nano」搭載 その他の「Feature Drops」も一気に紹介

「Pixel 8 Pro」にGoogleの生成AIモデル「Gemini Nano」搭載 その他の「Feature Drops」も一気に紹介

GoogleはOpenAIのGPT-4と競合する新生成AIモデル「Gemini」を発表した。その最小モデル「Gemini Nano」は「Tensor 3」搭載の「Pixel 8 Pro」で利用可能に。今年最後の多数の「Feature Drops」も紹介した。 「Android 14」正式版リリース ロック画面のカスタマイズが容易に/「AI壁紙」も導入

「Android 14」正式版リリース ロック画面のカスタマイズが容易に/「AI壁紙」も導入

Googleが10月5日、Android 14の正式版をリリースした。カスタマイズピッカーを使ってロック画面や壁紙を簡単に調整できるようになる。Pixel 8/8 Pro向けにはAIが自動で壁紙を生成する機能も導入する。 「AIのGoogle」復活に強い意志 Google I/O 2023で発表されたAIサービスまとめ

「AIのGoogle」復活に強い意志 Google I/O 2023で発表されたAIサービスまとめ

Googleは日本時間の5月11日2時から、年次開発者会議「Google I/O 2023」を開催しました。今回はデバイスに加えて、AIを活用したサービスも発表しています。発表内容を見ると、「AIのGoogle」復活に向けた強い意志を感じるものでした。 Googleの対話型AIサービス「Bard」は何に役立つ? 的確な回答を得られるヒントなどが公開

Googleの対話型AIサービス「Bard」は何に役立つ? 的確な回答を得られるヒントなどが公開

Google Japanは12月1日、対話型AIサービス「Bard」が日本でどのように活用されているのかを調査し、ランキング形式で発表した。調査は5月10〜11月15日に行われた。Bardが何に役立つのかが一目で分かるランキングの他、より的確な回答を得るヒントなども公開された。 Googleの対話型AI「Bard」を試してみた ChatGPTやBingよりも優れている点は?

Googleの対話型AI「Bard」を試してみた ChatGPTやBingよりも優れている点は?

Googleが3月に一般提供を開始した実験的な会話形AI「Bard」。これまで米国と英国からしか利用できませんでしたが、4月18日から日本からも利用が可能になりました。せっかくなので、新しいBingやChatGPT(GPT-3.5)とBardに同じ質問をして、その回答を比べてみました。

関連リンク

Copyright © ITmedia, Inc. All Rights Reserved.

アクセストップ10

- 3社そろい踏みの「Starlink Direct」 料金で仕掛けるドコモとソフトバンク、先行するKDDIは“サービス”で差別化 (2026年04月25日)

- 楽天モバイル、ルーター「Rakuten WiFi Pocket 5G」の販売を一時停止 理由は? (2026年04月24日)

- スマホの「残価設定」にメス? 総務省がルール統一を検討も、Appleは「不当な扱い」と猛反発 (2026年04月25日)

- ダイソーで1100円の「USB充電器(PD20W)」は、きちんと20Wで充電できるのか? (2026年04月26日)

- ソフトバンクが「今回もやる」とGalaxy S26を月額1円で販売――販売方法を早急に見直さないと撤退を迫られるメーカーも (2026年03月08日)

- 携帯電話のホッピング問題、「6カ月以内の継続利用を認める」方向で決着か 2026年夏に結論 (2026年04月23日)

- Xiaomiの前に、中国スマホの“雄”だったMeizu、またしてもピンチ (2026年04月26日)

- 1.72型ディスプレイ搭載スマートバンド「Xiaomi Smart Band 10」、高精度の睡眠モニタリングも可能 (2026年04月25日)

- 「Pixel 10a」と「Pixel 10」どちらを選ぶ? 実機比較で分かった「約5万円差の価値」と「明確な違い」 (2026年04月20日)

- 「Pixel 10」と「Pixel 10a」は直販で4.9万円差 この差をどう考える? (2026年04月25日)