AppleがWWDC21で示した情報操作の未来:WWDC21レポート(3/4 ページ)

ARの融合:ARの活用がより日常的に

秋以降のiPhoneとiPadでは、現実の風景にコンピューター映像を融合させたAR(拡張現実)を活用する画面も増えそうだ。

例えば三差路や五差路といった複雑な場所で、どっちの方向に進んだらいいか分からない時、新しいApple Mapでは周囲の建物をカメラでスキャンして正確な方角を割り出し、通りの上に通り名を表示したり、目的地へのルートを表示したりといったことが可能になる。これは2020年に発表されたARkit 4という技術でARオブジェクトを指定した緯度経度で表示する技術を使って実現している。

残念ながらまだ米国のいくつかの主要都市でしか利用できないが、今回、米国外の都市として初めてロンドンが追加された。来年以降、東京や大阪など日本の都市も追加されることを期待したい。

自分の街がこの機能に対応してくれると、例えば街中の決まった場所に案内や伝言、バーチャルなパブリックアートを置くことが可能になり、ARを日常生活の中で活用するシーンが一気に増えそうだ。

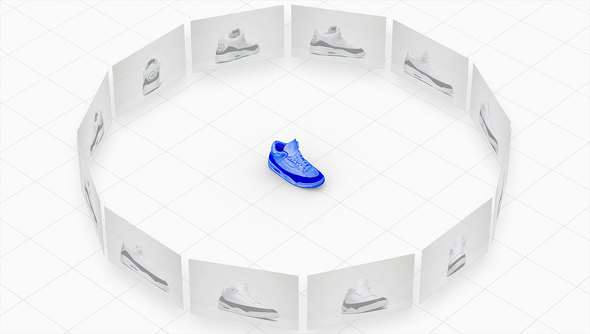

AR関連の発表で、もう1つ見逃せないのが「Object Capture」という技術だ。これはネット販売をしたい商品や、バーチャル展示をしたいアート作品を周囲360度からグルリと撮影することで、それをAR表示が可能な3Dオブジェクトに変換してくれる技術である。

残念ながらユーザーがすぐに使える形では搭載されていないが、開発者がこうした機能を簡単にアプリに組み込めるようになるため、OSリリース後、比較的すぐにたくさんのアプリが出てくるはずだ。

同様の機能を既に独自に実現していた「Qlone 3D」というアプリが、iOS 15のリリース後にこのObject Captureへの対応を表明しているので、このアプリが最初に試せるかもしれない。

3Dオブジェクト化した商品は、Eコマースサイトやバーチャル展覧会のWebサイトに掲載すれば、WebサイトをiPhoneで訪問した人が自分の部屋に実物大で表示して楽しむことができる。

一般ユーザーでも比較的簡単にARコンテンツをつくれる、このような技術が出てくることで2022年以降はARがこれまで以上に身近になってくるかもしれない。

今回のWWDCでは、Appleのデザイン部門のメンバーが空間とのインタラクションをどうデザインしたら良いかを教えているセッションもあり、方向感覚の分かるU1チップを搭載したiPhoneでAirDropやAirTagの機能をどのようにデザインしたかを語っている(“Design for spatial interaction”)。

インテリジェンス:認識するカメラ 進化した検索

Appleのインテリジェンス技術といえば、真っ先に思いつくのがSiriだろう。だが、WWDCの基調講演ではSiriの登場は少なかった。HomePodを使った家電のコントロールや、より自然な英語発声、プライバシー保護のために多くの処理をネット接続がない状況でもiPhone本体内でこなせるようになったこと、通知に邪魔されず作業に集中するための「集中モード」で緊急性を要する通知を見分けて知らせてくれる部分で触れられたくらいだ。

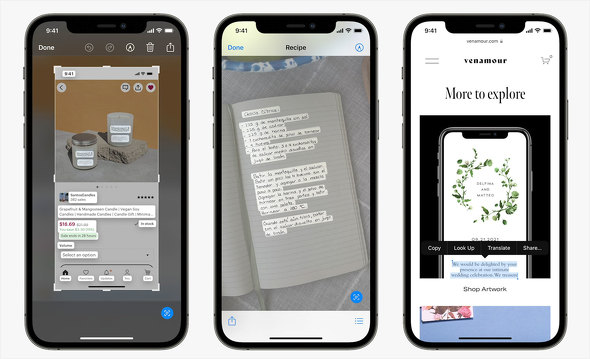

一方で、画像認識やSpotlightに関しては多くの発表があった。最も衝撃的なのは「Live Text」という技術だろう。会議が終わった後に、ホワイトボードに手書きされたアイデアを撮影すると、手書き文字が自動的に文字として認識され、選択後、文字情報としてメールなどにコピー&ペーストできる。

撮影したお店の看板に電話番号が書いてあれば、そこをタップして電話をかけることもできる。

もちろん、撮影済みの写真を、写真内に写っていた単語を使って検索といったことも可能だ。

残念ながら最初は英語など7カ国語しかないが、対応言語の1つに中国語がある。漢字の認識ができるのであれば、日本語への対応もさほど時間がかからないのではないかと期待をしてしまう。

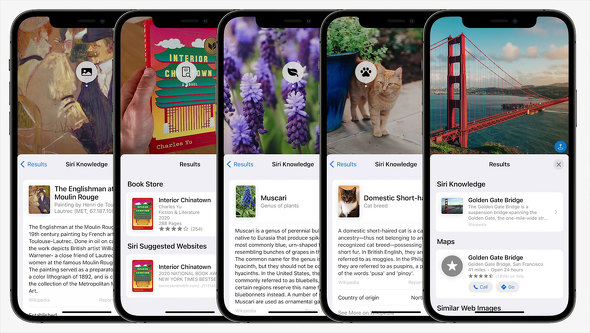

ちなみに、例えば犬の写真をタップすると自動的に犬種を認識して説明を表示したり、花を撮影すればその種類が分かったりと、被写体に関しての詳しい情報を表示する機能も搭載される。

認識できるジャンルは多岐に渡っており、アート、本、自然、ペットや有名観光名所などを含むランドマークなども認識し、キーワードを使って該当写真を検索することもできる。

この写真検索の機能は、「写真」アプリを起動しなくてもiOSのホーム画面の検索窓からも直接検索できるようになる。つまりキーワードや地名を打ち込むと、すぐに該当する人物、風景、物の写真が検索結果として表示されるのだ。対応する7言語であれば、写真中の文字情報も検索できるので、撮影したレシピや領収書、手書きメモなどもすぐに見つけられる。

Spotlightで、もう1つうれしい進化が知人の検索だ。仕事仲間や友達などの名前を入力して検索をすると、連絡先に登録した情報が表示され、即座に電話、メッセージ送信などができるのはもちろん、相手が位置情報を共有していれば地図で位置情報を表示してくれるし、相手に自分の位置情報を(一時的に)共有したければ、その操作もワンタッチで行える。

さらには最近、メッセージアプリなどで最後の会話の内容や、共有した写真、カレンダーに登録された一緒に参加する予定やメモなど、その人に関する情報を全てまとめて表示してくれる。

ちなみにSpotlightでは、日本語にも対応しているかは現時点では不明だが、有名人やTV番組、映画などの情報も表示されるようになるという。

ここまでiPhone標準の検索機能が強化されると、今後はインターネット検索の頻度が少し下がりそうだ。

関連記事

AppleがWWDC21で示した巨大プラットフォーマーの責務

AppleがWWDC21で示した巨大プラットフォーマーの責務

Appleの開発者向けイベント「WWDC21」が開幕した。さまざまなOSの多岐に渡る進化ポイントを、林信行氏がまとめた。 WWDC21で新ハードウェアは出なくとも「Apple Siliconが戦略の中心」と感じた理由

WWDC21で新ハードウェアは出なくとも「Apple Siliconが戦略の中心」と感じた理由

Appleの開発者会議「WWDC」が今年も開催。新ハードウェアや新チップの発表はなかったが、各OSのアップデートや連携の強化といった全体を見渡してみると、やはりApple Siliconが戦略の中心にあると感じられた。 macOSの新バージョンは「Monterey(モントレー)」 2021年秋にリリース

macOSの新バージョンは「Monterey(モントレー)」 2021年秋にリリース

macOSの新バージョン「Monterey(モントレー)」の概要が発表された。開発者向けのプレビュー版は配信を開始しており、一般ユーザーも試せるパブリックβ版は7月から配信される予定だ。 AppleがHomeKitの機能強化を発表

AppleがHomeKitの機能強化を発表

Appleが「HomeKit」の新機能を発表した。いずれも2021年秋にリリースされる予定だ。 WWDC21で新ハードウェアは出なくとも「Apple Siliconが戦略の中心」と感じた理由

WWDC21で新ハードウェアは出なくとも「Apple Siliconが戦略の中心」と感じた理由

Appleの開発者会議「WWDC」が今年も開催。新ハードウェアや新チップの発表はなかったが、各OSのアップデートや連携の強化といった全体を見渡してみると、やはりApple Siliconが戦略の中心にあると感じられた。

Copyright © ITmedia, Inc. All Rights Reserved.

アクセストップ10

- 「次世代Apple Intelligence」をフル活用するにはどのような条件がある? 「Siri AI」は日本で使える? 知っておくべき対応モデルのハードル (2026年06月09日)

- 「macOS 27 Golden Gate」が2026年秋に登場 初のApple Silicon専用バージョンに (2026年06月09日)

- 実売1万円切りでパススルー給電にも対応! KTCの15.6型モバイルディスプレイ「H15F9」は“買い”か (2026年06月09日)

- 初のカラー対応「Kindle Scribe Colorsoft」の実力は? 通常モデルとの価格差1万7000円の価値を検証 (2026年06月10日)

- 「Geminiの技術は使うが、Geminiではない」 WWDC26で見えたApple流AIとプライバシー戦略の核心 (2026年06月10日)

- Apple Siliconはなぜ「オンデバイスAI」に強いのか? NVIDIA「RTX Spark」との比較で読み解くシリコン設計の哲学 (2026年06月08日)

- 高騰中のSSD、品薄のHDD──けれど“最終処分”のニーズは変わらず (2026年06月06日)

- ミニPCに強みの「MINISFORUM」 ミニワークステーションの新モデルから「謎の拡張カード」まで多彩な製品を披露 (2026年06月10日)

- 新GPU「RX 9070 GRE」搭載カード発売! 既存上位モデル「RX 9070 XT」との価格差に悩む声も (2026年06月08日)

- コンパクトボディーにスパコン並みのAI性能! 「NVIDIA RTX Spark」搭載ミニデスクトップPCを見てきた (2026年06月04日)