Tegra K1もApple A8Xも圧倒する高性能へ――NVIDIA、世界初“1TFLOPS”モバイルプロセッサ「Tegra X1」:タブレットからクルマの自動運転まで(2/2 ページ)

NVIDIAは未来の車載システムを視野に

一方で問題は、これだけ高性能のモバイルプロセッサを何に活用するかという点だ。一般的なモバイルプロセッサと比較しても非常に高い性能を持つ最新Tegraについて、NVIDIAは「車載システム」に注目している。

車載システムは自動車の制御に加え、最近では「インフォテインメント」と呼ばれるエンターテインメントと情報システムを組み合わせた付加機能、さらに自動制御や運転者支援システムとしてのセンサー連動、リアルタイム認識処理に注目が集まりつつある。

NVIDIAでは、今後車載システムの複雑化により、搭載されるディスプレイや表示情報は飛躍的に増加し、年間で倍々ペース、2020年には2000万ピクセル以上の表示情報を同時に処理することになると見込んでいる。表示ディスプレイも従来のカーナビゲーションやエアコン等の操作パネルだけでなく、運転席のダッシュボードやバックミラー、後部座席や周辺ボタンの操作パネルなど、広い範囲に及ぶ。

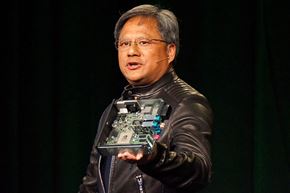

これら多くの表示情報を同時処理するための車載インフォテインメントシステムとして、Tegra X1を搭載した「NVIDIA Drive CX」プラットフォームを発表した。これにより、例えばナビゲーションは緻密な3Dモデルがアニメーション動作する地図となり、タコメーターの表示も自在にカスタマイズできるなど、より高度な表示に対応する。

車内に複数のディスプレイが設置された環境でも高度なグラフィックス処理が可能で、例えば完全な3Dモデルによるナビゲーションシステムや自在にカスタマイズ可能なタコメーターの表示など、複数ディスプレイへのさまざまな描画処理を同時に行える

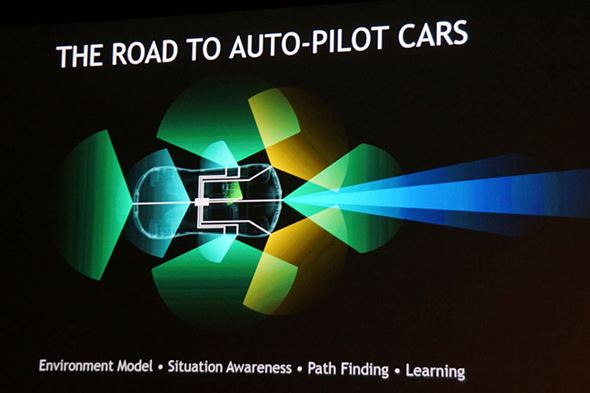

車内に複数のディスプレイが設置された環境でも高度なグラフィックス処理が可能で、例えば完全な3Dモデルによるナビゲーションシステムや自在にカスタマイズ可能なタコメーターの表示など、複数ディスプレイへのさまざまな描画処理を同時に行えるまた最近、米国では自動運転による走行実験が盛んになりつつあるが、これを支える技術として各種センサーと、車上でリアルタイムの高速処理による運転判断を実現できるシステムの連携が重要となっている。

ADAS(Advanced Driver Assistance Systems)という運転者の安全を補助する複数種のセンサーを組み合わせた衝突検知システムがあるが、ファン氏によれば、将来的に高度化されたカメラセンサーと認識システムにより、これら機能の代替が可能になるという。つまり、カメラと物体のリアルタイム認識のみで自動運転につながる仕組みを実現できるというわけだ。

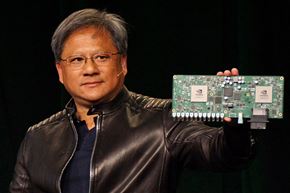

これを実現するのが「NVIDIA Drive PX」で、12系統のカメラ映像入力に対応し、それを処理するためのTegra X1を2個搭載することで、高度な機械学習によるリアルタイムの物体検知が可能になるという。

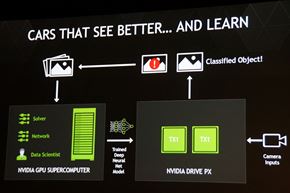

カメラ映像に映った物体を、機械学習を通して作成した分岐により自動的にクラス分類し、運転判断に利用する。もし認識できない物体だったとしても、そのデータをセンターのスーパーコンピュータへとフィードバックし、さらに学習処理を進めた認識情報をDrive PXへと配布することで、時間の経過とともに自動的に賢くなる仕組みだ。

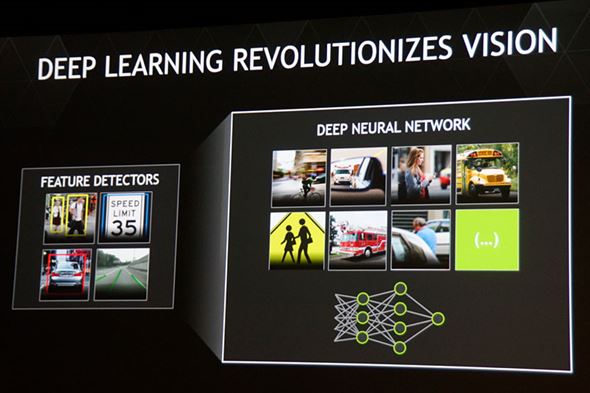

車載システムにおける物体の認識では、従来は「標識ごと」「人物ごと」といったように機能ごとの処理が別々に行われる傾向があったが、機械学習によるクラス分けにより、画面内で複数の対象オブジェクトを同時に識別できるようになる

車載システムにおける物体の認識では、従来は「標識ごと」「人物ごと」といったように機能ごとの処理が別々に行われる傾向があったが、機械学習によるクラス分けにより、画面内で複数の対象オブジェクトを同時に識別できるようになる

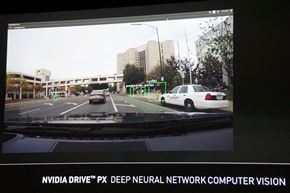

機械学習を十数時間実行後に実際に路上でオブジェクトの自動認識機能を実行したところ。歩行者か自転車走行かの区別のほか、対象が木や自動車の影に頻繁に隠れるようなケースでも追跡できる。また夜間でも標識の認識が可能で、速度制限や監視カメラを識別している

機械学習を十数時間実行後に実際に路上でオブジェクトの自動認識機能を実行したところ。歩行者か自転車走行かの区別のほか、対象が木や自動車の影に頻繁に隠れるようなケースでも追跡できる。また夜間でも標識の認識が可能で、速度制限や監視カメラを識別している

識別できなかったオブジェクトは「不明」として処理され、NVIDIA Drive PXを通じてデータセンターのスーパーコンピュータへとフィードバック(写真=左)。それをさらに学習することで自動的にDrive PXのクラス認識能力が向上する仕組みだ。この応用で、例えば駐車場の駐車状況や構造を把握し、自動的に駐車をさせることもできる(写真=右)

識別できなかったオブジェクトは「不明」として処理され、NVIDIA Drive PXを通じてデータセンターのスーパーコンピュータへとフィードバック(写真=左)。それをさらに学習することで自動的にDrive PXのクラス認識能力が向上する仕組みだ。この応用で、例えば駐車場の駐車状況や構造を把握し、自動的に駐車をさせることもできる(写真=右)壇上にはAudiのエレクトロニクス開発担当エグゼクティブバイスプレジデントのリッキー・フーディ氏が登場し、同社が現在取り組んでいるインフォテインメントシステムや、自動運転への取り組みの経緯について説明した。

同社はTegra K1を採用した車載システムをすでに一部車種に展開しているほか、昨年2014年9月にはカリフォルニア州公道での自動運転テストの許可を得たことが知られている。今後も、こうした最新プロセッサやセンサー技術を活用することで、より高度で安全な運転システムの開発や展開を進めていくことになるだろう。

関連記事

注目タブレット性能レビュー:“Denver”Tegra K1を搭載した「Nexus 9」の“持ち心地”と“性能”を試す

注目タブレット性能レビュー:“Denver”Tegra K1を搭載した「Nexus 9」の“持ち心地”と“性能”を試す

Googleが投入した8.9型ディスプレイ搭載タブレットは、64ビットに対応したOSとプロセッサを採用した。その“Android新時代”な性能を検証してみた。 日本上陸:NVIDIAの最強ゲーミングタブレット「SHIELDタブレット」徹底レビュー

日本上陸:NVIDIAの最強ゲーミングタブレット「SHIELDタブレット」徹底レビュー

SHIELDタブレットはゲーミングにフォーカスしたスペシャル仕様のAndroidタブレットだ。使用感をチェック! Tegra K1搭載:ゲーマー向け“最強”8型タブレット「SHIELDタブレット」日本上陸

Tegra K1搭載:ゲーマー向け“最強”8型タブレット「SHIELDタブレット」日本上陸

NVIDIAは、8型WUXGA液晶を搭載するAndroidタブレット「SHIELDタブレット」を10月10日に発売する。グラフィックス性能はiPad Airの倍以上。 Apple A7の3倍近い性能:NVIDIA、192基のCUDAコアを搭載する「Tegra K1」

Apple A7の3倍近い性能:NVIDIA、192基のCUDAコアを搭載する「Tegra K1」

NVIDIAは「Logan」の名で呼ばれていた次期モバイル向けSoc「Tegra K1」を発表した。 “お絵描きタブレット”になる?:動画で見る「Tegra Note 7」実機体験会

“お絵描きタブレット”になる?:動画で見る「Tegra Note 7」実機体験会

NVIDIAが7型Androidタブレット端末「Tegra Note 7」を正式発表。最新Tegra 4の性能に加え、繊細なタッチの描画を実現する「DirectStylus」テクノロジーが見どころだ。体験会の様子を動画でチェック。 NVIDIAのTegra 4搭載7型タブレット「Tegra Note 7」がZOTACから

NVIDIAのTegra 4搭載7型タブレット「Tegra Note 7」がZOTACから

NVIDIAは、Tegra 4を採用した7型ディスプレイ搭載タブレット「Tegra Note 7」を正式に発表した。日本市場ではZOTACが12月4日から販売を開始する。 TegraはSnapdragonを超えたのか?:「Tegra Note 7」で“Tegra 4タブ”のリファレンス性能を確認する

TegraはSnapdragonを超えたのか?:「Tegra Note 7」で“Tegra 4タブ”のリファレンス性能を確認する

Nexus 7で採用されたTegra 3。だが、Nexus 7 新モデルではSnapdragon 800シリーズにその座を奪われてしまう。Tegra 4の実力は7型タブでもライバルを超えるのだろうか? NVIDIA、“Tegra 4”採用のタブレット端末プラットフォーム「Tegra Note」を発表

NVIDIA、“Tegra 4”採用のタブレット端末プラットフォーム「Tegra Note」を発表

NVIDIAは、同社ブログにてタブレット端末プラットフォーム「Tegra Note」の発表を行なった。 349ドル:NVIDIA、新型SoC「Tegra 4」内蔵のポータブルゲーム機「SHIELD」を6月に発売

349ドル:NVIDIA、新型SoC「Tegra 4」内蔵のポータブルゲーム機「SHIELD」を6月に発売

NVIDIAがAndroidゲーム機「SHIELD」を正式に発表、6月より出荷する。一般向け予約は5月20日から。 Mobile World Congress 2013:大解説! Tegra 4シリーズの「性能密度」に迫る

Mobile World Congress 2013:大解説! Tegra 4シリーズの「性能密度」に迫る

スマートフォンやタブレットの頭脳となるモバイルプロセッサの進化が、インテリジェントなカメラとビデオを実現する。それを可能にするTegra 4の「性能密度」とは? Tegra 4とは違います:NVIDIA、LTE機能を実装したA9ベースの「Tegra 4i」

Tegra 4とは違います:NVIDIA、LTE機能を実装したA9ベースの「Tegra 4i」

NVIDIAは、クアッドコア+省電力コアのARMベースプロセッサ「Tegra」の最新モデルを投入した。LTEモデムを統合するが、Tegra 4と異なり、A9ベースを採用する。 2013 International CES:NVIDIAブースで、Tegra 4の4K再生とSHIELDの姿をチェックする

2013 International CES:NVIDIAブースで、Tegra 4の4K再生とSHIELDの姿をチェックする

NVIDIAが2013 CESで発表した「Tegra 4」と「Project SHIELD」。展示ブースではそれぞれのサンプルで“NVIDIAの狙い”を来場者にアピールしている。 2013 International CES:「Tegra 4」と「SHIELD」で舵を切るNVIDIAの狙い

2013 International CES:「Tegra 4」と「SHIELD」で舵を切るNVIDIAの狙い

米NVIDIAのプレスカンファレンスで、「Tegra 4」の概要が明らかになった。また、この新プロセッサを内蔵したゲームコンソール「Project SHIELD」も公開した。 2012 International CES:ファン氏、Tegra 3の“忍者”に期待する

2012 International CES:ファン氏、Tegra 3の“忍者”に期待する

NVIDIAは、2012 International CESで「Tegra 3」の説明会を行った。同社CEOのジェンスン・ファン氏は、「Tegra 3には、明かしてない機能がある」という。 NVIDIAの「Tegra 3」、アウディ全車に搭載

NVIDIAの「Tegra 3」、アウディ全車に搭載

新世代のモバイル機器向けプロセッサ「Tegra 3」が2013年以降のアウディ全車に採用される。 NVIDIA、「Tegra 3」を正式に発表

NVIDIA、「Tegra 3」を正式に発表

NVIDIAは、“1+4”コア構成を採用するTegra 3を正式に発表した。“12コアのGeForce GPU”を搭載してPC相当の描画性能を実現するという。

関連リンク

Copyright © ITmedia, Inc. All Rights Reserved.

アクセストップ10

- 超大画面ディスプレイを持ち運べるスマートグラス「VITURE Beast」を2週間使って分かったこと (2026年06月02日)

- NVIDIAが新型プロセッサ「RTX Spark」でWindows PCに“再挑戦” 搭載PCは2026年秋に登場 (2026年06月01日)

- メインストリームPCにも最新技術を――Ultraのない「Coreプロセッサ(シリーズ3)」搭載AI PCは2カ月弱で70超に (2026年06月03日)

- デル、最新AMD Ryzen AI/Ryzen 100シリーズ搭載のCopilot+ PC「Dell S」などを発売 発表会レポート (2026年06月03日)

- 今度はゲームボーイ風! 7型液晶と操作ボタン付きドッキングステーション「Wokyis G7」を見てきた (2026年06月03日)

- ついに日本でも販売を開始したAIグラス「Ray-Ban Meta(Gen 2)」実機レビュー 完成度は高いが課題も (2026年05月29日)

- Windows 11のレスポンス改善が徐々に浸透中 最新アップデートの実力とMicrosoft AI戦略の転換点 (2026年06月01日)

- 「最初は高いが、かえって安い」顧客満足度1位を支えるモノ作り VAIOの糸岡社長が語る“値上げ”の真意と次なる挑戦 (2026年06月03日)

- 初の液冷やLPCAMM2採用、全モデル5G対応も レノボが熱設計を一新した新型ワークステーションなど7機種を発表 (2026年06月03日)

- 乾電池で動く迷彩柄の屋外用監視カメラ ソースネクストが9980円で発売 (2026年06月03日)